Предупрежденията идват от всички страни - изкуственият интелект представлява екзистенциален риск за човечеството и трябва да бъде спрян, преди да е станало твърде късно.

Но какви са тези апокалиптични сценарии и как се предполага, че машините ще унищожат човечеството?

„Кламери на съдбата“

Повечето сценарии за бедствия започват от едно и също място: машините ще надхвърлят човешките възможности, ще се изплъзнат от човешкия контрол и ще откажат да бъдат изключени.

"Щом имаме машини, които имат цел за самосъхранение, значи сме в беда", заяви на събитие този месец академикът по изкуствен интелект Йошуа Бенгио.

Но тъй като тези машини все още не съществуват, представата за това как те биха могли да обрекат човечеството, често е оставено на философията и научната фантастика.

Философът Ник Бостром пише за "експлозията на интелигентността", която, според него, ще настъпи, когато свръхинтелигентните машини започнат да проектират свои собствени машини.

Той илюстрира идеята с историята за свръхинтелигентен изкуствен интелект във фабрика за кламери за хартия.

ИИ има за крайна цел да увеличи производството на кламери и затова "продължава да превръща първо Земята, а след това все по-големи части от наблюдаемата вселена в кламери".

Идеите на Бостром са отхвърляни от мнозина като научна фантастика, не на последно място заради твърденията му, че човечеството е компютърна симулация, и е подкрепял теории, близки до евгениката.

Неотдавна той се извини и след като беше открито расистко съобщение, изпратено от него през 90-те години на миналия век.

Въпреки това мислите му за изкуствения интелект оказаха огромно влияние, вдъхновявайки както Илон Мъск, така и професор Стивън Хокинг.

Терминатор

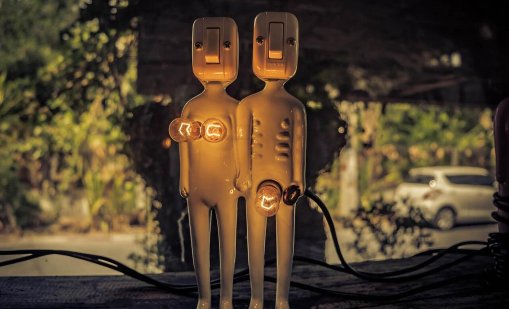

Ако свръхинтелигентните машини трябва да унищожат човечеството, те със сигурност се нуждаят от физическа форма.

Червеноокият киборг на Арнолд Шварценегер във филма "Терминатор", изпратен от бъдещето от изкуствен интелект да сложи край на човешката съпротива, се оказа съблазнителен образ, особено за медиите.

Експертите обаче отхвърлят тази идея.

"Малко вероятно е тази научнофантастична концепция да се превърне в реалност през следващите десетилетия, ако изобщо някога се случи", пише в доклад от 2021 г. групата за агитации "Спрете роботите убийци".

Въпреки това групата предупреди, че предоставянето на власт на машините да вземат решения за живота и смъртта е екзистенциален риск.

Експертът по роботи Керстин Даутенхан от Университета Ватерло в Канада омаловажи тези опасения.

Тя заяви пред АФП, че е малко вероятно изкуственият интелект да даде на машините по-високи способности да разсъждават или да им вдъхне желание да убият всички хора.

"Роботите не са зли", каза тя, въпреки че призна, че програмистите могат да ги накарат да вършат зли неща.

По-смъртоносни химикали

Един не толкова откровено научнофантастичен сценарий предвижда "лоши актьори" да използват изкуствен интелект за създаване на токсини или нови вируси и да ги пуснат в света.

Оказва се, че големите езикови модели като GPT-3, използван за създаването на ChatGPT, са изключително добри в измислянето на нови ужасяващи химически агенти.

Група учени, които използват ИИ, за да помогнат за откриването на нови лекарства, провеждат експеримент, при който настройват своя ИИ, за да търси вместо тях вредни молекули.

Те успели за по-малко от шест часа да създадат 40 000 потенциално отровни агенти, съобщава списание „Nature Machine Intelligence“.

Експертът по изкуствен интелект Джоана Брайсън от училището "Херти" в Берлин заяви, че може да си представи някой да разработи начин за по-бързо разпространение на отрова като антракс.

"Но това не е екзистенциална заплаха", каза тя пред АФП. "Това е просто ужасно, ужасно оръжие."

Напреднали видове

Правилата на Холивуд повеляват, че епохалните катастрофи трябва да са внезапни, огромни и драматични, но какво ще стане, ако краят на човечеството е бавен, тих и не е окончателен?

"В най-мрачния край нашият вид може да свърши без наследник", казва философът Хю Прайс в рекламно видео за Центъра за изследване на екзистенциалния риск към Университета в Кеймбридж.

Но, според него, има и "по-малко мрачни възможности", при които хората, подсилени от напреднали технологии, могат да оцелеят.

"Чисто биологичните видове в крайна сметка стигат до своя край, тъй като наоколо няма хора, които да нямат достъп до тази технология", казва той.

Въображаемият апокалипсис често се представя в еволюционен план.

През 2014 г. Стивън Хокинг твърди, че в крайна сметка нашият вид вече няма да е в състояние да се конкурира с машините с изкуствен интелект, като заяви пред Би Би Си, че това може да "означава край на човешката раса".

Джефри Хинтън, който посвещава кариерата си на създаването на машини, наподобяващи човешкия мозък, напоследък за Google, говори по подобен начин за "свръхинтелигентност", която просто изпреварва хората.

Неотдавна той заяви пред американската телевизия PBS, че е възможно "човечеството да е само преходна фаза в еволюцията на интелигентността".

Анализ на Джоузеф Бойл за АФП

Това се случи Dnes, за важното през деня ни последвайте и в Google News Showcase.

„Комодор” срази „Аква спорт” в драматичен дуел на „Приморски”

„Комодор” срази „Аква спорт” в драматичен дуел на „Приморски”  Сачева: Правителството ще остане дотогава, докогато Бойко Борисов реши

Сачева: Правителството ще остане дотогава, докогато Бойко Борисов реши  "Войната" по пътищата взе нови нова жертва през последното денонощие

"Войната" по пътищата взе нови нова жертва през последното денонощие  Шофьори закъсаха в прохода "Петрохан" заради снега

Шофьори закъсаха в прохода "Петрохан" заради снега  АПИ към шофьорите: Тръгвайте на път готови за зимни условия

АПИ към шофьорите: Тръгвайте на път готови за зимни условия  Продължава поскъпването на основни хранителни стоки на борсите у нас

Продължава поскъпването на основни хранителни стоки на борсите у нас

Скок на цените на основни храни - кое ни излиза най-скъпо?

Скок на цените на основни храни - кое ни излиза най-скъпо?  Щетите след пожара в Трявна са зад 1 млн. лв., търсят се доброволци

Щетите след пожара в Трявна са зад 1 млн. лв., търсят се доброволци  Украйна обяви Ден на траур, Полша вдигна самолети след руските атаки (+СНИМКИ)

Украйна обяви Ден на траур, Полша вдигна самолети след руските атаки (+СНИМКИ)  СЗО зове за нови лекарства и тестове за гъбични инфекции

СЗО зове за нови лекарства и тестове за гъбични инфекции  АПИ към шофьорите: Тръгвайте на път със зимни гуми

АПИ към шофьорите: Тръгвайте на път със зимни гуми  Гърция е в челните позиции на европейския туризъм за Великден

Гърция е в челните позиции на европейския туризъм за Великден

Любопитно! Куриоз на „Герена“ с дългогодишна история

Любопитно! Куриоз на „Герена“ с дългогодишна история  Браво! Националният отбор на България трети на световното първенство по спортен риболов

Браво! Националният отбор на България трети на световното първенство по спортен риболов  Жесток удар за Челси

Жесток удар за Челси  Замениха Александър Георгиев в мач от НХЛ

Замениха Александър Георгиев в мач от НХЛ  Томаш продължава да си играе с огъня

Томаш продължава да си играе с огъня  Левски без героя от Вечното дерби под Аязмото – ето групата на „сините“

Левски без героя от Вечното дерби под Аязмото – ето групата на „сините“

Михаел Шумахер стана дядо за първи път

Михаел Шумахер стана дядо за първи път  Дъщерята на Гала – Мари, разказа за тежката си битка с рака

Дъщерята на Гала – Мари, разказа за тежката си битка с рака  Седмична нумерологична прогноза за 7 – 12 април

Седмична нумерологична прогноза за 7 – 12 април  Брокат и сърца в маникюрите (+Снимки)

Брокат и сърца в маникюрите (+Снимки)  10 ефикасни храни против киселини

10 ефикасни храни против киселини  Шоколадов сладкиш с шамфъстък

Шоколадов сладкиш с шамфъстък

продава, Тристаен апартамент, 59 m2 Добрич област, с.Кранево, 68000 EUR

продава, Тристаен апартамент, 59 m2 Добрич област, с.Кранево, 68000 EUR  продава, Двустаен апартамент, 68 m2 Варна, Виница, 116300 EUR

продава, Двустаен апартамент, 68 m2 Варна, Виница, 116300 EUR  продава, Двустаен апартамент, 67 m2 Варна, Виница, 111911 EUR

продава, Двустаен апартамент, 67 m2 Варна, Виница, 111911 EUR  продава, Двустаен апартамент, 67 m2 Варна, Виница, 115300 EUR

продава, Двустаен апартамент, 67 m2 Варна, Виница, 115300 EUR  продава, Двустаен апартамент, 68 m2 Варна, Виница, 116300 EUR

продава, Двустаен апартамент, 68 m2 Варна, Виница, 116300 EUR  продава, Тристаен апартамент, 60 m2 София, Красна Поляна, 99800 EUR

продава, Тристаен апартамент, 60 m2 София, Красна Поляна, 99800 EUR